14/08/2011

En el vasto universo de la ciencia cognitiva y la inteligencia artificial, emerge una perspectiva que desafía las concepciones tradicionales sobre cómo pensamos y aprendemos: el conexionismo. Esta teoría propone que la mente no opera como una máquina lógica que manipula símbolos de forma secuencial, sino como una intrincada red de unidades de procesamiento interconectadas, inspiradas en la compleja estructura de nuestro propio cerebro. Es una visión que nos invita a explorar la cognición desde una óptica radicalmente diferente, donde el conocimiento no reside en reglas explícitas, sino en la fuerza y los patrones de conexión entre sus componentes.

El conexionismo, también conocido como procesamiento distribuido en paralelo (PDP) o, de forma más general, como el estudio de las redes neuronales artificiales, busca comprender la inteligencia humana y diseñar sistemas artificiales que puedan emularla. Lejos de ser una moda pasajera, ha demostrado ser una fuerza transformadora, ofreciendo explicaciones convincentes para fenómenos que van desde el reconocimiento de patrones hasta el aprendizaje del lenguaje. Pero, ¿cómo funciona exactamente este enfoque y por qué ha generado un debate tan apasionado con las teorías clásicas de la inteligencia artificial?

- ¿Qué es la Teoría Conexionista?

- Un Vistazo a la Historia del Conexionismo

- Principios Básicos y Características del Conexionismo

- El Gran Debate: Conexionismo vs. IA Convencional

- Tipos de Redes Conexionistas

- El Conexionismo y la Mente: Implicaciones Filosóficas

- Preguntas Frecuentes sobre el Conexionismo

- ¿Cuál es la diferencia fundamental entre el conexionismo y la IA clásica?

- ¿Cómo aprenden las redes conexionistas?

- ¿Puede el conexionismo explicar la complejidad del lenguaje humano?

- ¿Las redes neuronales artificiales son iguales al cerebro humano?

- ¿Cuáles son las limitaciones actuales del conexionismo?

¿Qué es la Teoría Conexionista?

La teoría conexionista es un paradigma en la ciencia cognitiva que modela los procesos mentales como la emergencia de la actividad de grandes conjuntos de unidades de procesamiento simples, interconectadas entre sí. A diferencia de los enfoques simbólicos que postulan que la cognición se basa en la manipulación de símbolos discretos y reglas formales, el conexionismo sugiere que el conocimiento se almacena en la fuerza o 'peso' de las conexiones entre estas unidades, y que el procesamiento de la información ocurre a través de la propagación de la activación a lo largo de la red.

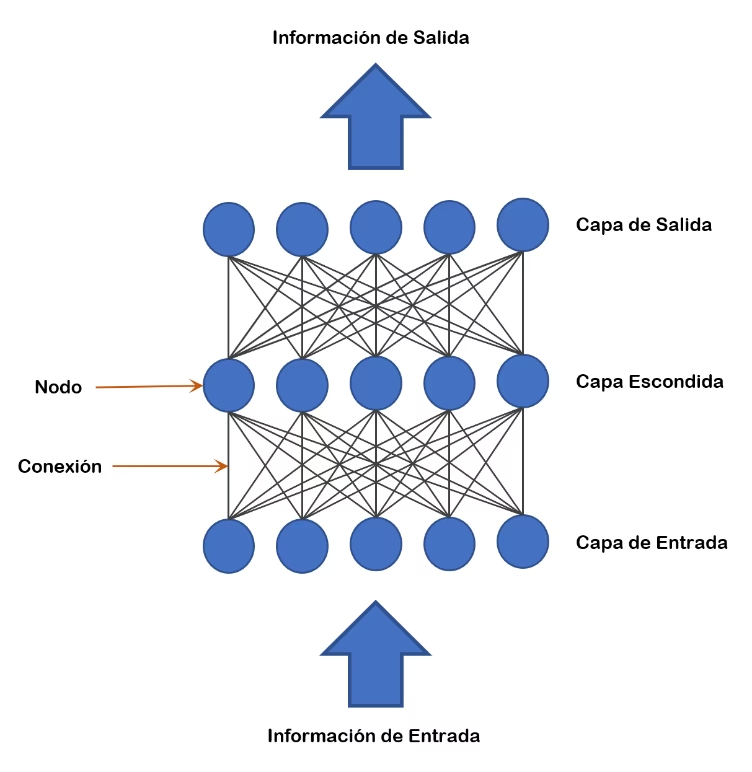

Estas unidades, a menudo llamadas 'neuronas' artificiales, no son representaciones directas de neuronas biológicas individuales, sino abstracciones que capturan sus propiedades computacionales esenciales. Cada unidad tiene un nivel de activación numérico (por ejemplo, un valor que va de 0 a 1), y su influencia sobre otras unidades conectadas está determinada por el peso de la conexión. La interacción cooperativa y competitiva entre estas unidades permite que la red aprenda y reconozca patrones complejos en los datos de entrada, produciendo respuestas apropiadas.

En esencia, el conexionismo nos dice que la inteligencia no es el resultado de un plan maestro centralizado o de un conjunto de instrucciones predefinidas, sino de la autoorganización y la interacción dinámica de muchos elementos simples que operan en procesamiento paralelo. Es una metáfora poderosa que nos acerca más a la forma en que el cerebro, con sus miles de millones de neuronas y trillones de sinapsis, logra realizar tareas cognitivas asombrosas.

Un Vistazo a la Historia del Conexionismo

La historia del conexionismo es una montaña rusa de entusiasmo, desilusión y resurgimiento. Sus raíces se remontan a la década de 1940, cuando el neurofisiólogo Warren McCulloch y el lógico Walter Pitts (1943) demostraron que estructuras similares a neuronas, que actúan e interactúan basándose en unos pocos principios neurofisiológicamente plausibles, podían interconectarse para realizar cálculos lógicos complejos. Observaron que la actividad de las neuronas es de carácter "todo o nada" y que, para activarse, la influencia excitatoria neta de otras neuronas debe alcanzar un cierto umbral. Su trabajo pionero sentó las bases matemáticas para las futuras redes neuronales, mostrando cómo una red de tres unidades podía calcular una conjunción lógica, y cómo redes más complejas podían realizar cálculos más intrincados, incluso emulando la capacidad de una máquina de Turing.

Paradójicamente, las propuestas de McCulloch y Pitts fueron una fuente principal de inspiración para el trabajo de John von Neumann sobre cómo crear una máquina de Turing universal a partir de componentes electrónicos. La llegada de estos dispositivos de computación electrónica y el desarrollo posterior de lenguajes de programación de alto nivel aceleraron enormemente el ascenso del enfoque clásico formal de la cognición, inspirado en la lógica formal y basado en sentencias y reglas. Sin embargo, los propios McCulloch y Pitts tuvieron la previsión de ver que el futuro de las redes neuronales artificiales no residía en su capacidad para implementar cálculos formales, sino en su habilidad para participar en tareas más "desordenadas" como el reconocimiento de patrones distorsionados y la resolución de problemas que requieren la satisfacción de múltiples restricciones "suaves".

En la década de 1950, figuras como Donald Hebb (1949) propusieron la famosa 'regla de Hebb': "neuronas que se activan juntas, se conectan juntas" (neurons that fire together, wire together), sugiriendo que la conexión entre dos neuronas se fortalece cuando ambas están activas simultáneamente. Esta idea fundamental sobre la plasticidad sináptica se tradujo en una fórmula matemática que permitió a los modelos conexionistas modificar los pesos de sus propias conexiones en función de los patrones de entrada-salida encontrados. Frank Rosenblatt, con su invención del 'perceptrón' en 1958, llevó estas ideas a la práctica, demostrando que estas redes podían aprender a clasificar patrones mediante la "regla delta", un algoritmo de corrección de errores que ajustaba los pesos para reducir la diferencia entre la activación deseada y la real de una unidad de salida.

Sin embargo, la euforia inicial se vio empañada en 1969 con la publicación de "Perceptrons" por Marvin Minsky y Seymour Papert. Ellos demostraron que los perceptrones simples tenían limitaciones fundamentales, como la incapacidad de resolver el problema de la función XOR (o exclusiva), que requiere una separación no lineal de los datos. Esta crítica, aunque enfocada en la arquitectura de perceptrones de dos capas sin unidades ocultas, llevó a una "hibernación" del campo durante más de una década, con una reducción drástica en el interés y la financiación.

El gran resurgimiento llegó en la década de 1980, gracias a avances clave como la "regla delta generalizada" (Rumelhart, Hinton y Williams, 1986), que permitió el entrenamiento de redes con múltiples capas ocultas mediante el algoritmo de retropropagación del error (backpropagation). Este avance superó las limitaciones de los perceptrones de una sola capa y abrió la puerta a la creación de modelos mucho más potentes y complejos. El compendio de dos volúmenes "Parallel Distributed Processing" (PDP) de David Rumelhart, James McClelland y sus colegas en 1986, marcó un hito, presentando una plétora de modelos conexionistas exitosos para diversos procesos psicológicos, desde el reconocimiento del habla hasta el aprendizaje del tiempo pasado en verbos.

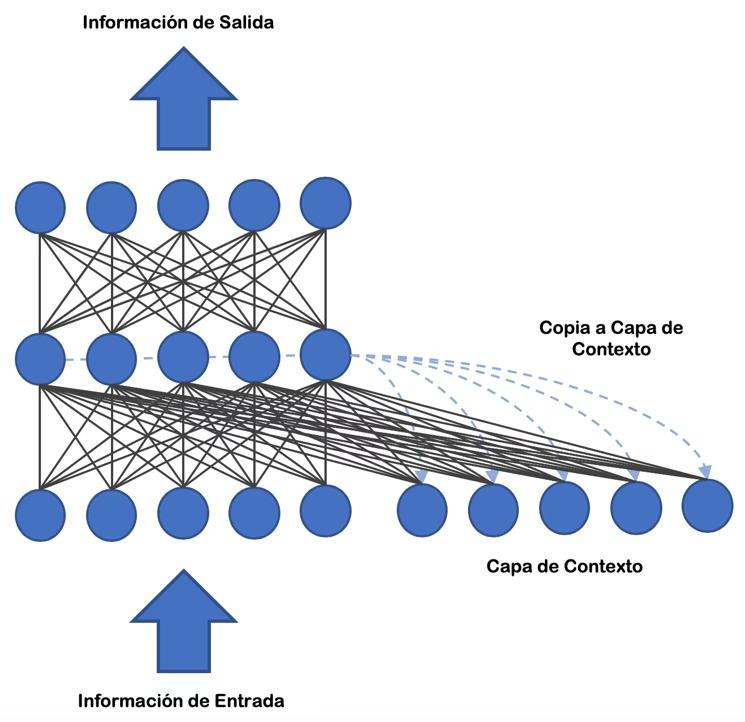

Desde entonces, el conexionismo ha florecido, con el desarrollo de arquitecturas especializadas como las redes recurrentes de Jeffrey Elman (1990) para el procesamiento del lenguaje y la memoria contextual (incorporando capas de unidades de contexto que retroalimentan la actividad a las unidades ocultas, permitiendo el procesamiento de información dependiente del tiempo), y los mapas autoorganizados de características (SOFM) de Teuvo Kohonen (1983) para el aprendizaje no supervisado y la formación de mapas topográficos similares a los encontrados en el córtex mamífero.

Principios Básicos y Características del Conexionismo

El conexionismo se asienta sobre varios pilares fundamentales que lo distinguen de otras aproximaciones a la inteligencia artificial y la cognición:

- Unidades de Procesamiento: Son los componentes básicos de una red, análogas a las neuronas. Cada unidad tiene un nivel de activación numérico, que puede variar en un rango continuo (por ejemplo, entre 0 y 1).

- Conexiones Ponderadas: Las unidades están interconectadas por enlaces que tienen un 'peso' numérico. Estos pesos pueden ser positivos (excitatorios) o negativos (inhibitorios) y determinan la fuerza y la dirección de la influencia de una unidad sobre otra. La influencia de la unidad 'i' sobre la unidad 'u' se calcula como el producto de la activación de 'i' y el peso de la conexión de 'i' a 'u' (Influencia_iu = a_i * w_iu). El conocimiento del sistema se codifica y almacena en estos pesos.

- Función de Activación: Cada unidad tiene una función de activación que determina su nivel de salida en función de la suma ponderada de sus entradas. Funciones comunes incluyen la función escalón (con un umbral nítido) y la función sigmoide (que produce una curva en forma de 'S'), que introducen no linealidades esenciales para el aprendizaje de patrones complejos y permiten que la red sea sensible a un rango continuo de entradas.

- Propagación de la Activación: El procesamiento de la información se realiza mediante la propagación de la activación de una unidad a otra a través de las conexiones ponderadas. En redes de alimentación hacia adelante (feedforward), la información fluye unidireccionalmente de las unidades de entrada, a través de una o más capas ocultas, hasta las unidades de salida. Las redes recurrentes permiten conexiones bidireccionales y bucles de retroalimentación, lo que les confiere memoria contextual y capacidad para procesar secuencias temporales.

- Aprendizaje Distribuido: La capacidad más distintiva del conexionismo es su habilidad para aprender. Esto implica la modificación sistemática de los pesos de las conexiones en respuesta a la experiencia o a un error. Los algoritmos de aprendizaje, como la regla de Hebb (que fortalece conexiones entre unidades co-activas), la regla delta (que ajusta pesos basándose en la diferencia entre la activación deseada y la real) y, sobre todo, la retropropagación (una versión generalizada de la regla delta que propaga el error hacia atrás a través de las capas ocultas), ajustan estos pesos para reducir la discrepancia entre la salida deseada y la generada por la red.

- Representaciones Distribuidas: A menudo, la información no está codificada en una única unidad (codificación localista, donde una unidad específica representa una entidad), sino en patrones de actividad distribuidos sobre un conjunto de unidades (codificación distribuida). Esto significa que cada unidad participa en la representación de múltiples entidades (codificación gruesa o 'coarse coding'), lo que confiere a las redes robustez frente a fallos (degradación gradual, donde la red sigue funcionando incluso si parte de ella se daña) y capacidad para generalizar a entradas novedosas o ruidosas.

Estas características permiten a las redes conexionistas detectar patrones estadísticos complejos en grandes volúmenes de datos y responder de manera sensata a entradas imperfectas, una ventaja clave sobre los sistemas simbólicos tradicionales que tienden a fallar catastróficamente ante pequeñas imperfecciones en el código o las entradas.

El Gran Debate: Conexionismo vs. IA Convencional

Desde su resurgimiento en los años 80, el conexionismo ha mantenido un intenso debate con el enfoque clásico o convencional de la inteligencia artificial (IA). Este debate ha sido fundamental para dar forma a la ciencia cognitiva y la filosofía de la mente.

Aquí una tabla comparativa de sus principales diferencias:

| Característica | Inteligencia Artificial Convencional (Clásica) | Conexionismo |

|---|---|---|

| Modelo Subyacente | Simbólico, reglas formales, similar a una máquina de Turing. No se asemeja directamente a la estructura cerebral subyacente. | Inspirado en el cerebro (neuronas, conexiones). Modelado de "bajo nivel", buscando semejanza con estructuras neurológicas. |

| Representación del Conocimiento | Símbolos explícitos (modelos mentales), reglas sintácticas para su manipulación. | Información almacenada en forma de conexiones (pesos) entre neuronas. Aprendizaje mediante estímulos del medio. |

| Procesamiento | Serial, manipulación de símbolos explícitos mediante aplicación de reglas sensibles a la sintaxis. | Paralelo, propagación de activación a través de la red. La manipulación de símbolos explícitos es vista como una representación muy pobre de la actividad mental. |

| Aprendizaje | Generalmente requiere programación explícita de reglas. A menudo postula subsistemas simbólicos de dominio específico (lenguaje, números). | Mediante ajuste de pesos de conexión (ej. retropropagación). Postula uno o un pequeño conjunto de mecanismos de aprendizaje muy generales. |

| Robustez / Generalización | Mayor tendencia a fallar o colapsar debido a imperfecciones menores en el código o las entradas. | Tolerante a fallos (degradación gradual). Responde sensiblemente a entradas ruidosas o imperfectas. Excelente generalización. |

| Interpretación | Relativamente fácil de interpretar (las reglas y símbolos son explícitos). | A menudo "caja negra", más oscuro, difícil de interpretar cómo se llega a una solución. Describible solo en términos muy generales. |

Los críticos, como Jerry Fodor y Steven Pinker, argumentaron que el conexionismo corría el riesgo de ignorar los avances de la IA clásica en la comprensión de la cognición como manipulación de símbolos. Plantearon que la mente opera a través de un "lenguaje del pensamiento" (mentalese) y que el conexionismo, al centrarse en asociaciones de bajo nivel, no podía explicar fenómenos como la sistematicidad (la capacidad de entender una frase implica entender sus variantes sistemáticas) y la productividad del pensamiento (la capacidad de generar un número infinito de pensamientos gramaticales).

El famoso "debate del pasado" (Rumelhart y McClelland vs. Pinker y Prince) sobre cómo los niños aprenden la morfología verbal irregular fue un campo de batalla clave. Los conexionistas demostraron que sus modelos podían replicar la curva de aprendizaje en forma de U de los niños (donde los niños inicialmente aprenden formas irregulares, luego las "regularizan" en exceso, y finalmente aprenden tanto las reglas como sus excepciones) sin reglas explícitas, lo que sugería que un mecanismo de aprendizaje asociativo general podría ser suficiente. Aunque esta línea de investigación fue criticada por la estructura artificial de su corpus de entrenamiento, trabajos posteriores han abordado estas deficiencias.

A pesar de las diferencias, muchos investigadores hoy en día ven ambos enfoques como complementarios. Algunos sugieren que la arquitectura conexionista podría ser la forma en que los sistemas de manipulación de símbolos se implementan en el cerebro. La visión actual tiende hacia una coexistencia pacífica y la integración de técnicas de ambos paradigmas, reconociendo que cada uno ofrece fortalezas únicas para diferentes niveles de análisis de la cognición. La reciente popularidad de los sistemas dinámicos en la filosofía de la mente ha añadido una nueva perspectiva, argumentando que la división principal es entre la IA convencional y los sistemas dinámicos, con el conexionismo a menudo cooptando técnicas de estos últimos.

Tipos de Redes Conexionistas

Más allá de los modelos de alimentación hacia adelante (feedforward) básicos, el conexionismo ha desarrollado una rica variedad de arquitecturas de red, cada una diseñada para abordar diferentes tipos de problemas cognitivos:

- Redes de Alimentación Hacia Adelante (Feedforward Networks): Son las más simples, donde la información fluye en una sola dirección, desde la capa de entrada, a través de una o más capas ocultas (unidades no visibles para el entorno), hasta la capa de salida. Son excelentes para tareas de clasificación, reconocimiento de patrones estáticos y mapeos de entrada-salida.

- Redes Recurrentes (Recurrent Neural Networks - RNNs): A diferencia de las redes feedforward, las RNNs tienen conexiones que forman bucles, permitiendo que la información persista y se retroalimente, lo que les confiere una forma de memoria. Esto las hace ideales para el procesamiento de secuencias temporales, como el lenguaje natural, el habla y la música. Las "redes Elman" son un ejemplo clásico de RNNs, que utilizan unidades de contexto para capturar información del paso temporal anterior, permitiendo a la red aprender dependencias a largo plazo. Otro tipo son las redes de "atractor", donde las actividades de las unidades se asientan gradualmente en un patrón estable en respuesta a una entrada fija.

- Redes Autoorganizadas: Un ejemplo prominente son los Mapas Autoorganizados de Características (SOFM) de Kohonen. Estas redes aprenden de manera no supervisada, ajustando sus pesos para que unidades cercanas en la red respondan a entradas similares, creando así un mapa topográfico de los datos de entrada. Son útiles para la visualización de datos, el agrupamiento y han mostrado características biológicamente interesantes, como la representación de vectores de entrada similares con unidades vecinas y la expansión de porciones del mapa para discriminar entre entradas frecuentes.

- Redes de Activación Interactiva y Competencia (IAC): Modelos como los propuestos por McClelland y Rumelhart utilizan conexiones excitatorias e inhibitorias bidireccionales entre grupos de unidades. En los modelos IAC, los pesos suelen ser predefinidos (o ajustados mediante otros métodos como el análisis estadístico de datos naturales) y las unidades compiten entre sí para activarse, asentándose finalmente en un estado estable. Son efectivos para modelar fenómenos de memoria a largo plazo, como la recuperación de información basada en el contenido, el priming y la comprensión del lenguaje.

- Redes Profundas (Deep Networks): Aunque no son un "tipo" de conexionismo en sí mismas, sino una evolución, las redes profundas son la encarnación moderna del conexionismo, utilizando múltiples capas ocultas para aprender representaciones jerárquicas y abstractas de los datos. El "aprendizaje profundo" (deep learning) ha revolucionado campos como la visión por computadora y el procesamiento del lenguaje natural, llevando las ideas conexionistas a una escala sin precedentes y demostrando capacidades de generalización impresionantes.

Cada una de estas arquitecturas, con sus algoritmos de aprendizaje asociados, contribuye a la versatilidad y el poder del enfoque conexionista para modelar y comprender una amplia gama de fenómenos cognitivos, desde el aprendizaje de la percepción hasta la toma de decisiones complejas.

El Conexionismo y la Mente: Implicaciones Filosóficas

El resurgimiento del conexionismo en los años 80 no solo fue un avance técnico, sino que también tuvo profundas implicaciones filosóficas, desafiando las concepciones arraigadas sobre la naturaleza de la mente.

Una de las promesas más atractivas del conexionismo fue su capacidad para tender un puente entre la neurociencia de bajo nivel y la psicología de alto nivel. Mientras que la IA clásica a menudo se desentendía de los detalles cerebrales, argumentando que los procesos cognitivos podían ser realizados por cualquier sustrato físico (la idea de "realizabilidad múltiple"), el conexionismo enfatizó que para entender la cognición humana, debemos prestar atención al tipo de mecanismo físico que la instancía. La forma en que las neuronas están conectadas y se activan es intrínseca a cómo se procesa la información en el cerebro.

Filósofos como Patricia y Paul Churchland han argumentado que el conexionismo socava la "psicología popular" (nuestra concepción pre-científica de la mente, que postula la manipulación interna de representaciones similares a sentencias) y la visión clásica de que las creencias y deseos se almacenan como "sentencias" internas. Para ellos, las redes neuronales sugieren que los pensamientos son más bien "puntos" en un espacio neural de alta dimensión y las secuencias de pensamientos son "trayectorias" a través de este espacio. Esto implica una visión más fluida y menos estructurada de la representación mental, sugiriendo que la estructura del efecto (nuestros pensamientos expresados en lenguaje) no refleja directamente la estructura de su causa (la actividad cerebral subyacente).

Daniel Dennett, aunque reconoce la naturaleza conexionista de nuestros mecanismos internos, adopta una postura más moderada. Sostiene que, si bien la neurociencia no encontrará "sentencias internas", la psicología popular sigue siendo una herramienta indispensable para predecir y explicar el comportamiento humano a un nivel de abstracción más alto. Es como entender a un jugador de ajedrez no por sus circuitos internos, sino por su estrategia, una "postura intencional" que nos da un poder predictivo útil al ignorar detalles de bajo nivel. Dennett argumenta que, aunque un ingeniero eléctrico podría predecir el comportamiento de una máquina de ajedrez con mayor precisión a nivel de circuito, se empantanaría en esos detalles, haciendo inútil su ventaja predictiva en tiempo real.

En última instancia, el conexionismo nos invita a reconsiderar cómo la información es codificada, procesada y aprendida. Sugiere que la inteligencia puede emerger de la interacción de componentes simples y que la complejidad del pensamiento no reside en reglas explícitas, sino en la intrincada danza de activaciones y conexiones en una vasta red. Aunque el debate con la IA clásica persiste, el conexionismo ha consolidado su lugar como un pilar fundamental en la búsqueda de comprender la mente.

Preguntas Frecuentes sobre el Conexionismo

A continuación, respondemos algunas de las preguntas más comunes sobre esta fascinante área de estudio:

¿Cuál es la diferencia fundamental entre el conexionismo y la IA clásica?

La diferencia fundamental radica en su metáfora central de la mente. La IA clásica ve la mente como una computadora que manipula símbolos abstractos y reglas explícitas (un enfoque de "alto nivel"), mientras que el conexionismo la ve como una red de unidades interconectadas que procesan información en paralelo, inspiradas en el cerebro (un enfoque de "bajo nivel"). El conocimiento en la IA clásica es explícito y simbólico; en el conexionismo, es implícito y se distribuye en los pesos de las conexiones.

¿Cómo aprenden las redes conexionistas?

Las redes conexionistas aprenden ajustando la fuerza (pesos) de las conexiones entre sus unidades en respuesta a la experiencia. Los algoritmos de aprendizaje, como la retropropagación del error, comparan la salida de la red con una "salida deseada" y modifican los pesos para reducir el error. Este proceso iterativo permite a la red "descubrir" los patrones subyacentes en los datos y generalizar a nuevas entradas. La regla de Hebb y la regla delta son ejemplos de algoritmos de aprendizaje que modifican los pesos en función de la co-activación o el error, respectivamente.

¿Puede el conexionismo explicar la complejidad del lenguaje humano?

Sí, el conexionismo ha realizado importantes avances en la explicación del lenguaje. Modelos recurrentes, como las redes Elman, han demostrado la capacidad de aprender estructuras gramaticales complejas y procesar dependencias a largo plazo en secuencias de palabras al incorporar "memoria" del contexto previo. Aunque el debate con las teorías lingüísticas innatistas persiste, el conexionismo ofrece un marco para entender cómo el lenguaje puede ser adquirido a través de mecanismos de aprendizaje generales y la exposición a datos lingüísticos, sin la necesidad de un "dispositivo innato de adquisición del lenguaje" preconfigurado.

¿Las redes neuronales artificiales son iguales al cerebro humano?

No, las redes neuronales artificiales son modelos simplificados inspirados en el cerebro, no réplicas exactas. Capturan algunas de las propiedades computacionales esenciales de las neuronas biológicas y sus conexiones (como la activación umbral y la influencia excitatoria/inhibitoria), pero abstraen muchos de los detalles neurofisiológicos y bioquímicos. Son herramientas para explorar principios cognitivos y desarrollar IA, no simulaciones biológicamente fieles en su totalidad. Buscan capturar las propiedades computacionales esenciales de grandes conjuntos de elementos neuronales reales.

¿Cuáles son las limitaciones actuales del conexionismo?

A pesar de sus éxitos, el conexionismo enfrenta desafíos. Algunas redes, especialmente las de retropropagación, pueden sufrir "interferencia catastrófica" (el aprendizaje de nueva información puede sobrescribir o distorsionar la antigua). A menudo, requieren grandes cantidades de datos y muchas iteraciones de entrenamiento para alcanzar un rendimiento competente y exhibir una generalización adecuada, lo que contrasta con el aprendizaje de "una sola vez" que los humanos demuestran en ciertas situaciones. La "plausibilidad biológica" de algunos algoritmos de aprendizaje (como la retropropagación) también es un tema de debate, aunque se han propuesto procedimientos más plausibles. Además, la "interpretabilidad" de lo que aprenden estas redes sigue siendo un desafío, ya que sus representaciones son distribuidas y a menudo opacas para el análisis humano, dificultando la comprensión precisa de los procesos cognitivos modelados.

Si quieres conocer otros artículos parecidos a El Conexionismo: Un Viaje a la Mente Conectada puedes visitar la categoría Metáforas.